-

[Ollama] 모델 저장위치 변경하기Data & ML & AI/LLM 2024. 7. 26. 19:36반응형

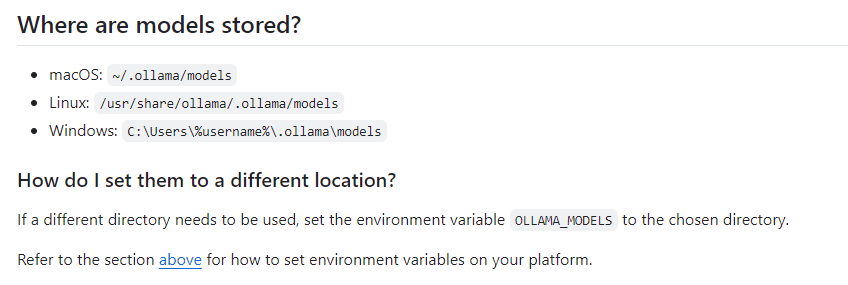

Ollama는 기본적으로 시스템 기본 위치에 설치되고 돌아갑니다.

윈도우라면 C드라이브, 리눅스라면 usr 밑에 깔립니다.

https://github.com/ollama/ollama/blob/main/docs/faq.md#where-are-models-stored 그런데 이런 위치에 모델을 깔기엔, 모델의 용량이 너무 무겁습니다.

(24년 7월 기준)- llama3.1:8b = 4.7GB

- llama3.1:70b = 40GB

- llama3.1:405b = 231GB

Ollama작동위치와 모델의 설치위치를 D드라이브나 기타 Block으로 변경해봅시다.

1. Ollama 설치 (기존과 동일)

curl -fsSL https://ollama.com/install.sh | sh2. 모델위치 환경설정 (기존엔 없었음)

# Environment="OLLAMA_MODELS=/folder/ollama/models" Environment="OLLAMA_MODELS=/home/work/ollama-test/ollama-models"3. Ollama Serve (변경O)

# 기본 # ollama serve # 변경 # OLLAMA_MODELS="/folder/ollama/models" ollama serve OLLAMA_MODELS="/home/work/ollama-test/ollama-models" ollama serve4. Ollama Run

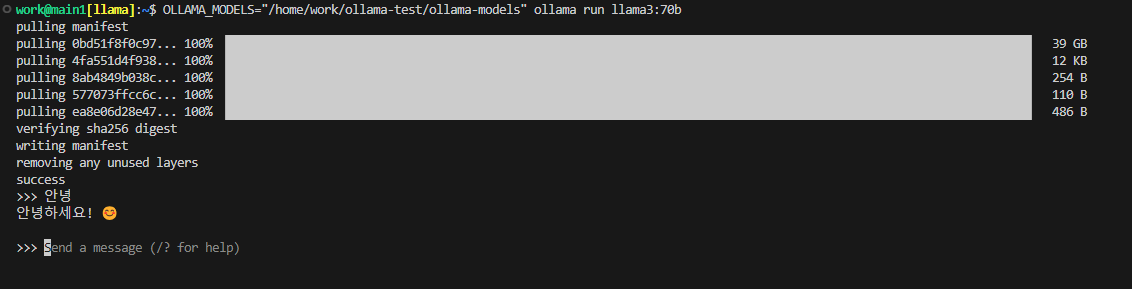

# 기존처럼 돌려도 됩니다. # ollama run llama3:70b # 아예 못박아서 안전하게 돌리고 싶다면 # OLLAMA_MODELS="/folder/ollama/models" ollama run llama3:70b OLLAMA_MODELS="/home/work/ollama-test/ollama-models" ollama run llama3:70b5. 결과

터미널에서 잘 돌아갑니다.

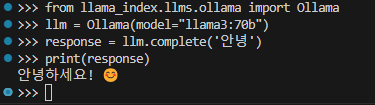

python에서도 특정한 설정 없이 잘 돌아갑니다. 참조: https://github.com/ollama/ollama/issues/680

윈도우 참조: https://www.youtube.com/watch?v=uj1VnDPR9xo

반응형'Data & ML & AI > LLM' 카테고리의 다른 글

[DeepSeek-r1] Ollama로 로컬 컴퓨터에 DeepSeek 쉽게 설치하기 (0) 2025.02.01 [LlamaIndex] Llama-Index와 DB 연동하기(DatabaseReader, feat. agent) (3) 2024.10.08 [Llama3] Ollama와 Llama-Index로 Llama3 쉽게 시작하기(ubuntu) (0) 2024.06.29 ChatGPT API로 서비스 구축하기 #3-2. Evaluate Inputs: Moderation (프롬프트 주입 방지하기) (4) 2023.11.28 ChatGPT API로 서비스 구축하기 #3-1. Evaluate Inputs: Moderation (윤리성 검토하기) (1) 2023.11.26